Esta respuesta la hemos traducido de la que apareció en Quora en Octubre de 2016 por Dave Haynie, ingeniero, músico, fotógrafo y jefe de ingeniería de Commodore y uno de los ingenieros del mítico Amiga. El énfasis es nuestro.

Esta respuesta la hemos traducido de la que apareció en Quora en Octubre de 2016 por Dave Haynie, ingeniero, músico, fotógrafo y jefe de ingeniería de Commodore y uno de los ingenieros del mítico Amiga. El énfasis es nuestro.

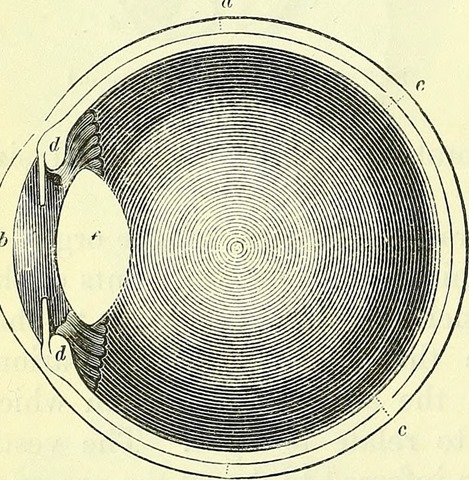

En realidad, un ojo no se puede equiparar con una cámara real… pero sigue leyendo.

En la mayor parte de las cámaras digitales lo que tenemos son píxeles ortogonales. Dichos píxeles se distribuyen de manera equidistante a través del sensor, formando una rejilla casi perfecta. Disponemos además de un filtro, generalmente se trata de un filtro de Bayer (debe su nombre al científico Bryce Bayer, quien inventó la matriz de colores que se usa hoy en día), para píxeles rojos, azules y verdes.

Si hacemos un paralelismo con el ojo, deberíamos pensar en un sensor con unos 120 millones de píxeles. Existe una mayor densidad de píxeles en el centro del sensor, y tan solo alrededor de 6 millones de estos filtran de modo que permiten sensibilidad al color. Y por supuesto, ¡únicamente 100.000 de ellos son capaces de detectar el color azul!

Además, este sensor no sería plano sino, de hecho, semiesférico, lo que permitiría usar una sencilla lente sin que se produzcan distorsiones: las lentes de las cámaras reales deben proyectar sobre superficies planas, lo cual resulta poco natural dada la forma esférica que poseen las lentes más comunes (de hecho, las lentes más sofisticadas cuentan con elementos no esféricos).

Esto nos daría una diagonal de aproximadamente 22 mm de media, que es un poco más grande que un micro-sensor de 4/3... Pero la naturaleza esférica implica que la superficie sería alrededor de 1.100mm2, un poco más grande que el sensor de una cámara full-frame de 35mm. La resolución en píxeles más alta en un sensor de 35mm la encontramos en una cámara Canon 5Ds, que mete 50.6Mpixels en unos 860mm2.

Y hasta aquí hemos hablado del hardware del ojo. Pero debemos tener en cuenta que este no es el único factor que limita la resolución efectiva. Aunque parece que el ojo está “continuamente” viendo, sin embargo, esta acción es cíclica: existe lo que podemos llamar una velocidad de fotogramas muy elevada... Sin embargo, esto no es lo importante. Lo realmente influyente son los movimientos involuntarios oculares (micro-temblores) que ocurren a una frecuencia entorno a los 70-110Hz. Nuestro cerebro está constantemente componiendo la salida de nuestro ojo mientras este se mueve sobre la verdadera imagen que percibimos, y a no ser que la imagen se mueva demasiado rápido, dado que la imagen final se construye a partir de múltiples muestras, se consigue que la resolución efectiva final pase de 120Mpíxeles a 480Mpíxeles.

Lo cual tiene perfecto sentido: nuestros cerebros se enfrentan a este tipo de problema en forma de procesamiento paralelo, con un rendimiento comparable a los supercomputadores más rápidos que tenemos hoy en día.

Cuando percibimos una imagen, hay un procesamiento de imágenes de bajo nivel y procesos especializados que trabajan en abstracciones en un nivel superior. Por ejemplo, los humanos somos realmente buenos en el reconocimiento de líneas horizontales y verticales, mientras que el simple cerebro de nuestras amigas las ranas se ha especializado en la búsqueda y reconocimiento de pequeños objetos volantes a través de su campo visual (esa mosca que se acaban de comer). Los humanos además establecemos continuamente relaciones entre lo que vemos y nuestros recuerdos. Por lo que cuando vemos un objeto no nos limitamos a mirarlo, sino que inmediatamente lo reconocemos y echamos mano de toda una biblioteca de información sobre lo que acabamos de ver.

Otro aspecto interesante de nuestro procesamiento de imágenes en el cerebro es que no exigimos ninguna resolución en particular. A medida que nuestros ojos envejecen y no podemos ver tan bien, nuestra resolución efectiva cae, y, sin embargo, nos adaptamos. En un plazo relativamente corto, nos adaptamos a lo que el ojo en realidad es capaz de ver… y uno mismo puede experimentarlo en casa. Si tienes la edad suficiente como para haber pasado mucho tiempo delante una televisión de “definición estándar”, probablemente ya hayas experimentado esto. Tu cerebro se adaptó a la pésima calidad de la televisión NTSC (o la calidad ligeramente menos terrible pero todavía mala de la televisión PAL), y luego tal vez saltó a VHS, que era incluso peor de lo que podría obtener a través de la antena. Cuando se inició la era digital, entre el VideoCD y los primeros grabadores de vídeo digital (DVR, como el TiVo), la calidad era realmente pésima, pero si viste mucho contenido como ese, con el tiempo dejaste de notar la baja calidad. Sin embargo, un telespectador de la llamada televisión de “alta definición” de hoy en día, si ve algún programa con la calidad de tiempos pasados se sentiría decepcionado... Sobre todo porque su cerebro se habrá movido ya a la experiencia de video de alta calidad, habiendo desechado ya esas adaptaciones a la TV de mala calidad.

Volviendo un segundo a lo que comentábamos antes sobre que la imagen final estaba formada por múltiples muestras... Bien, existen cámaras que pueden hacer esto. En condiciones de poca luz, muchas cámaras actuales tienen la capacidad de promediar varias fotos diferentes sobre la marcha, lo que aumenta la señal y reduce el ruido... Tu cerebro también hace lo mismo en la oscuridad. En algunas cámaras incluso se ha logrado hacer el efecto del “micro-temblor” ocular. La cámara Olympus OM-D E-M5 Mark II tiene un modo "hi-res" que realiza 8 disparos con ajuste de 1/2 píxel, para ofrecer lo que son esencialmente dos imágenes de 16Mpixel en RGB completo (porque los pasos a píxeles completos aseguran que cada píxel se muestra en R, G, B, G), con una compensación cada 1/2 píxel. La interpolación de estas imágenes intersticiales como una cuadrícula de píxeles normal ofrece 64Mpíxel, pero la resolución efectiva se acerca más bien a 40Mpixel… aun así supone un gran salto desde los 16Mpixels. Hasselblad obtuvo un resultado similar en 2013 logrando una captura de 200Mpixel, y Pentax también ha lanzado una cámara con una característica similar incorporada.

También se están realizando versiones simplificadas de funciones de alto nivel del cerebro en nuestras cámaras. Las cámaras de hoy en día disponen de reconocimiento facial, seguimiento, enfoque continuo, etc. Ni se acercan a la calidad de la combinación de nuestro ojo/cerebro, pero no lo hacen mal para el mal hardware que tienen.

Al fin y al cabo tan solo llevan unos pocos cientos de millones de años de retraso…

Nota: Imagen página 261 del "On the anatomy of vertebrates" (1866) del Internet Archive Book Images.